Pourquoi les ordinateurs modernes sont-ils tellement meilleurs que les anciens ? Une explication est liée au nombre considérable de progrès réalisés dans le domaine de la puissance de microtraitement au cours des dernières décennies. Environ tous les 18 mois, le nombre de transistors pouvant être pressés sur un circuit intégré double.Cette tendance a été observée pour la première fois en 1965 par le cofondateur d’Intel, Gordon Moore, et est communément appelée « loi de Moore ». Les résultats ont propulsé la technologie vers l’avant et l’ont transformée en une industrie de mille milliards de dollars, dans laquelle des puces incroyablement puissantes peuvent être trouvées dans tout, des ordinateurs domestiques aux voitures autonomes en passant par les appareils ménagers intelligents.Mais la loi de Moore ne pourra peut-être pas continuer indéfiniment. Le secteur de la haute technologie pourrait adorer parler de croissance exponentielle et de « fin de rareté » pilotée par le numérique, mais il existe des limites physiques à la capacité de réduire continuellement la taille des composants d’une puce.

Qu’est-ce que La loi de Moore ?

La loi de Moore, c’est d’abord le constat d’un homme, Gordon Moore, pionnier d’Intel, en 1965 : tous les 18 mois, le nombre de transistors sur une puce double. Une idée simple, mais qui a redessiné le paysage technologique. Les dernières générations de puces, avec leurs milliards de transistors, échappent déjà totalement à l’œil nu. Si on prolongeait cette trajectoire jusqu’en 2050, il faudrait bâtir des transistors plus petits… qu’un atome d’hydrogène. Un défi pour l’imagination, mais surtout pour les ingénieurs.

Lire également : Technologie : Découvrez les différents types et usages

Réalité bien plus froide : chaque nouvelle usine à puces s’accompagne d’une facture colossale. Les coûts explosent. Beaucoup estiment que la cadence s’essoufflera dès le seuil des 5 nanomètres franchi, c’est-à-dire dès les années 2020. Faut-il imaginer un monde figé, condamné à tourner sous Windows 95 ad vitam ?

La réponse est nette : non. Le ralentissement ou l’arrêt de la loi de Moore ne sonnera pas l’arrêt du progrès informatique. Voici pourquoi, et comment l’innovation continuera d’avancer, différemment.

Lire également : Faut-il vraiment passer à une alternative à manytoon en 2026 ?

La loi de Moore ne finira pas « comme ça »

Personne ne se réveillera un matin pour découvrir que la gravité ou la vitesse de la lumière ont disparu. La loi de Moore, malgré son nom, n’est pas une loi naturelle : elle décrit une tendance, pas une fatalité. Comme une habitude prise par l’industrie, mais qui peut évoluer.

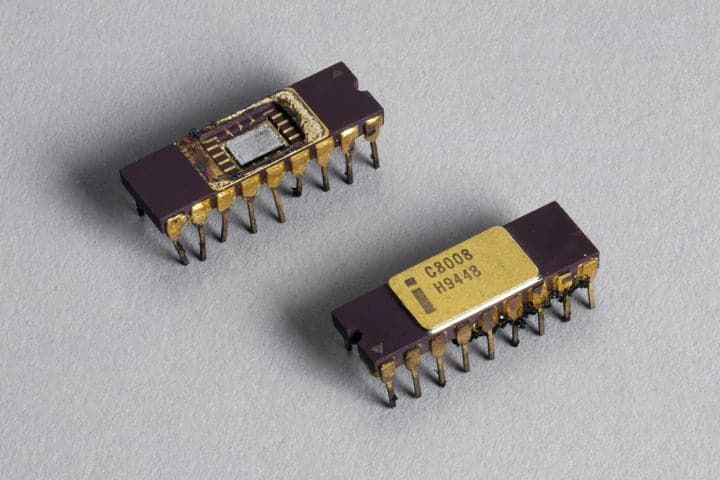

Les photos parlent : deux puces Intel 8080 des années 1970, des processeurs 486 et Pentium, un Xeon double cœur de 2006, puis l’i7 de 2017. L’évolution saute aux yeux, mais le changement ne s’arrêtera pas brutalement. Lorsque le doublement des transistors ralentit, le progrès continue, simplement à un autre rythme. Plus lent, mais toujours en marche.

On a exploité les ressources les plus accessibles ; désormais, il faut inventer de nouvelles méthodes, plus sophistiquées, pour repousser encore les limites.

Algorithmes et logiciels améliorés

Jusqu’ici, les développeurs pouvaient se permettre d’écrire des programmes peu optimisés, sachant que le matériel de l’année suivante absorberait la différence. Si la loi de Moore fléchit, cette époque touche à sa fin. Il deviendra vital d’extraire chaque once de performance du matériel existant. Pour cela, il faudra réinventer les logiciels, écrire des algorithmes plus efficaces, revoir l’expérience utilisateur, le design, la robustesse.

On le voit déjà : des équipes entières se consacrent à traquer les inefficacités, à affiner les lignes de code. Même sans nouveau bond matériel, l’optimisation logicielle peut offrir des années, voire des dizaines d’années, de progrès tangible.

Des puces plus spécialisées

L’une des réponses majeures à la fin de la croissance généralisée, c’est la spécialisation. Les GPU, conçus à l’origine pour l’affichage graphique, sont désormais incontournables dans la vision par ordinateur, le calcul scientifique, ou encore l’IA. D’autres processeurs ciblent des usages précis : réseaux neuronaux, reconnaissance vocale, objets connectés.

Avec la décélération de la loi de Moore, attendez-vous à voir fleurir une multitude de puces sur-mesure. Dans l’automobile, la santé, la robotique, les puces spécialisées s’imposeront. Elles promettent de meilleures performances par watt, une efficacité accrue pour chaque domaine. Intel, Google, Nvidia, IBM et bien d’autres ont déjà amorcé ce virage stratégique.

Comme avec les logiciels, la rareté des avancées génériques pousse les ingénieurs à inventer des architectures inédites, taillées pour chaque besoin.

Il ne s’agit plus seulement des puces

À l’époque de Gordon Moore, l’informatique se résumait à ce qui se passait sur la puce, dans la boîte. Aujourd’hui, le calcul se déplace : le cloud computing redistribue les cartes. De plus en plus de tâches, surtout celles qui demandent une puissance considérable, ne sont plus réalisées sur votre ordinateur ou votre téléphone, mais déportées sur d’immenses serveurs.

Le cloud permet à un simple smartphone de profiter d’une puissance de calcul démultipliée, sans changer de processeur local. C’est le cas pour l’intelligence artificielle, la reconnaissance vocale, la traduction automatique. La réponse est traitée à distance, puis transmise à votre appareil. Résultat : des machines toujours plus intelligentes, sans dépendre uniquement de la miniaturisation des composants.

Nouveaux matériaux et configurations

Le silicium a donné son nom à la Silicon Valley. Mais déjà, les chercheurs bousculent les règles. Intel, par exemple, s’attaque à la fabrication de transistors en 3D, empilés les uns sur les autres au lieu d’être simplement posés à plat. D’autres pistes émergent : l’usage de matériaux issus des groupes III et V du tableau périodique, capables de conduire mieux que le silicium.

Impossible de savoir aujourd’hui si ces nouveaux matériaux passeront à l’échelle industrielle, ni à quel coût. Pourtant, avec la force de frappe des géants du secteur et la pression de l’innovation, il est probable que la relève du silicium se prépare déjà dans l’ombre.

Informatique quantique

L’informatique quantique reste, pour l’instant, un pari fou. Cette technologie, expérimentale et onéreuse, change totalement la donne. Ici, le bit classique, 0 ou 1, laisse place au qubit, capable d’être dans plusieurs états à la fois. L’effet ? Une puissance de calcul théorique vertigineuse, qui pourrait pulvériser les performances des ordinateurs actuels sur certains problèmes.

IBM, Google et d’autres explorent ce terrain. Reste à relever des défis techniques redoutables : maintenir les qubits dans un état stable, à des températures proches du zéro absolu. Si la percée arrive, le rythme de l’innovation pourrait s’emballer à une vitesse inédite, et faire oublier les limites du silicium.

Des choses que nous ne pouvons pas encore penser

Peu auraient parié, dans les années 1980, sur l’essor du smartphone ou la domination de Google et Amazon. Le futur ne se laisse jamais dompter d’avance. Peut-être l’informatique quantique sera-t-elle la prochaine révolution, peut-être pas. D’autres idées, aujourd’hui inimaginables, attendent leur heure.

Puces conçues à partir de matériaux inédits, architectures encore inconnues, méthodes radicalement nouvelles pour organiser l’information : le champ des possibles reste ouvert. Une certitude demeure : la créativité collective, soutenue par les défis techniques, continuera de façonner des outils que nous n’avons pas encore rêvés. Le progrès informatique ne s’arrête pas, il change de visage, et l’histoire n’a pas fini de nous surprendre.